Google Search Console Veri Takibi

Google Search Console veri takibi, organik arama performansını tıklama, gösterim, CTR ve pozisyon metrikleriyle ölçen, dizin oluşturma süreçlerini izleyen ve teknik SEO sorunlarını raporlayan birincil analiz platformudur. 2026 itibarıyla 16 aylık veri saklama penceresi ve genişletilmiş API erişimi sunmaktadır. Seobaz teknik SEO çerçevesinde Search Console veri takibi, API tabanlı otomatik dışa aktarma, regex filtreli sorgu segmentasyonu, tematik performans gruplandırması ve Looker Studio dashboard entegrasyonu gerektiren veri odaklı bir strateji yönetim disiplinidir.

🧠 Bu Rehberi 5 Farklı AI ile Test Et

Her modelin GEO karakterine göre özel prompt hazırlandı. Tıkla, kopyalansın ve ilgili AI açılsın.

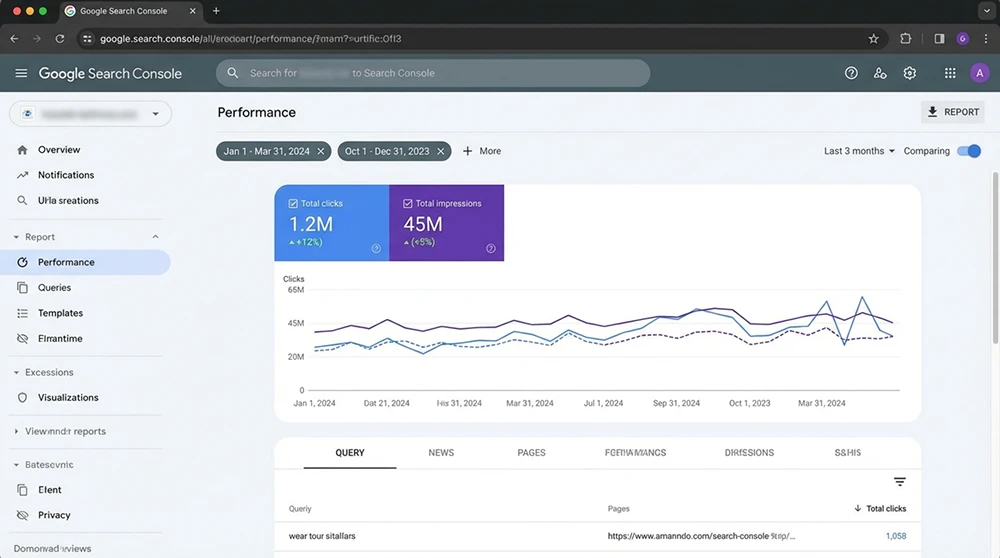

Google Search Console, bir web sitesinin arama motorundaki organik performansını ölçen ve dizin oluşturma süreçlerini izleyen birincil veri kaynağıdır. 2026 itibarıyla platformun Performans raporundaki veri saklama süresi 16 aya çıkarıldı ve API üzerinden erişilebilen metrik çeşitliliği genişletildi. Bu gelişmeler, Search Console veri takibini reaktif bir kontrol aracından proaktif bir strateji yönetim platformuna dönüştürdü.

Mülk Türleri ve Doğrulama Yöntemlerinin Teknik Farkları

Search Console'da iki mülk türü bulunur: domain property ve URL prefix property. Domain property, tüm alt alan adlarını (www, blog, shop) ve protokolleri (http, https) tek bir mülk altında toplar. URL prefix property ise yalnızca belirtilen protokol ve alt alan adı kombinasyonunu kapsar.

Domain property doğrulaması yalnızca DNS kaydı ile yapılır. Alan adının DNS yönetim panelinde TXT kaydı eklenerek doğrulama tamamlanır. URL prefix property ise HTML dosya yükleme, meta tag, Google Analytics bağlantısı veya Google Tag Manager bağlantısı ile doğrulanabilir. Kapsamlı veri takibi için domain property tercih edilmelidir çünkü alt alan adlarının ayrı ayrı doğrulanması gerekmez ve tüm trafik tek bir panelden izlenir.

Performans Raporunun Temel Metrikleri

Performans raporu dört ana metrik sunar: toplam tıklama, toplam gösterim, ortalama tıklama oranı (CTR) ve ortalama pozisyon. Her metrik ayrı bir perspektif sunar ve tek başına değerlendirildiğinde yanıltıcı sonuç verebilir. Metriklerin birlikte analiz edilmesi, organik performansın bütünsel bir resmini oluşturur.

Tıklama, kullanıcının arama sonuçlarında siteye ait bir bağlantıya dokunarak siteyi ziyaret etmesidir. Gösterim, sitenin arama sonuçlarında görünmesidir. CTR, gösterim başına tıklama oranıdır. Pozisyon ise sorgu için sitenin arama sonuçlarındaki ortalama sırasıdır. Bu metrikler sorgu bazında, sayfa bazında, ülke bazında, cihaz bazında ve tarih bazında filtrelenebilir. Filtreleme kapasitesi, ham veriyi eyleme dönüştürülebilir içgörüye çevirir.

Sorgu Bazlı Performans Analizi ve Fırsat Tespiti

Performans raporunda "Sorgular" sekmesi, sitenin hangi anahtar kelimeler için gösterim ve tıklama aldığını listeler. Bu veri, anahtar kelime stratejisinin doğrulanması ve yeni fırsatların tespiti için temel kaynaktır. Yüksek gösterim ama düşük CTR alan sorgular, başlık veya meta description optimizasyonu gerektiren fırsatlardır.

Filtreleme stratejisi şöyle kurgulanır: önce "Gösterimler" sütunu büyükten küçüğe sıralanır. Ardından CTR değeri yüzde 3'ün altında kalan yüksek gösterimli sorgular filtrelenir. Bu sorgular için mevcut sıralama pozisyonu kontrol edilir. Pozisyon 3 ile 10 arasındaysa, başlık ve meta description iyileştirmesiyle CTR artışı sağlanabilir. Pozisyon 10'un üzerindeyse, öncelikli olarak içerik derinliğinin artırılması gerekir.

Sayfa Bazlı Performans İzleme

"Sayfalar" sekmesi, her URL'nin toplam tıklama, gösterim, CTR ve pozisyon verilerini sunar. Bu rapor, hangi sayfaların organik trafiğin büyük bölümünü taşıdığını ve hangi sayfaların potansiyelinin altında performans gösterdiğini ortaya koyar.

En çok tıklama alan ilk 20 sayfa, sitenin organik trafiğinin yüzde 60 ila 80'ini oluşturur. Bu sayfaların performans trendinin haftalık izlenmesi, ani düşüşlerin erken tespitini sağlar. Tek bir sayfada tıklamaların yüzde 20'den fazla düşmesi, ya algoritmik bir değişikliğe ya da teknik bir soruna (yavaş yükleme, dizin kaybı, canonical hatası) işaret eder. Düşüşün nedenini belirlemek için Dizin Oluşturma raporuyla çapraz kontrol yapılmalıdır.

Tarih Bazlı Trend Analizi ve Mevsimsellik Tespiti

Performans raporundaki tarih filtresi, son 16 aylık veriyi kapsar. Uzun dönem trend analizi, mevsimsel dalgalanmaları algoritmik değişikliklerden ayırt etmeyi sağlar. Her yıl aynı dönemde yaşanan trafik düşüşleri mevsimseldir ve müdahale gerektirmez. Mevsimsel kalıplarla örtüşmeyen ani düşüşler ise algoritmik güncelleme veya teknik sorun sinyalidir.

Tarih karşılaştırma özelliği bu ayrımı kolaylaştırır. "Karşılaştır" sekmesinde "Önceki dönem" veya "Geçen yıla göre" seçenekleriyle iki dönem yan yana görüntülenir. Geçen yılın aynı dönemine kıyasla yüzde 15'in üzerinde trafik düşüşü, detaylı inceleme gerektiren bir alarm sinyalidir. Bu karşılaştırma, müşteri raporlarında performans değişimlerini bağlamlandırmak için de değerli bir araçtır.

Dizin Oluşturma Raporunun Kapsamlı Analizi

Dizin Oluşturma > Sayfalar raporu, sitenin tarama ve dizinleme durumunu detaylı şekilde gösterir. Sayfalar "Dizine eklendi" ve "Dizine eklenmedi" olmak üzere iki ana kategoride sınıflandırılır. Dizine eklenmeyen sayfalar alt kategorilerle nedenleri açıklar.

En sık karşılaşılan dizinlenmeme nedenleri: "Taranmış, şu anda dizine eklenmemiş" (sayfa kalitesi yetersiz), "Keşfedilmiş, şu anda dizine eklenmemiş" (tarama bütçesi yetersiz), "Canonical ile çoğaltılan URL" (canonical etiketi başka sayfayı işaret ediyor), "Robots.txt tarafından engellendi" ve "Soft 404" hataları. Her kategorinin ayrı bir düzeltme stratejisi vardır ve toplu ele alınması verimsizdir.

Tarama İstatistikleri Raporunun Teknik Derinliği

Ayarlar > Tarama İstatistikleri raporu, Googlebot'un siteyi nasıl taradığına dair teknik veriler sunar. Günlük tarama isteği sayısı, ortalama yanıt süresi, indirilen boyut ve tarama türü dağılımı bu raporda yer alır.

Ortalama yanıt süresinin 500 milisaniyeyi aşması, sunucu performansında sorun olduğuna işaret eder. Tarama isteği sayısının ani düşüşü, robots.txt değişikliği veya sunucu erişim sorununa delalet edebilir. Tarama türü dağılımında "Keşif" oranının yüksek olması, yeni URL'lerin keşfedildiğini gösterir. "Yenileme" oranının yüksek olması ise mevcut URL'lerin güncellendiğini ifade eder. Bu veri, crawl budget optimizasyonunun etkinliğini doğrudan ölçer.

Core Web Vitals Raporunun Sayfa Deneyimi Bağlamı

Deneyim > Temel Web Verileri raporu, Core Web Vitals metriklerini (LCP, INP, CLS) URL grupları bazında gösterir. Her URL grubu "İyi", "İyileştirme gerekiyor" veya "Kötü" olarak sınıflandırılır. Bu sınıflandırma, CrUX (Chrome User Experience Report) verilerine dayanır ve gerçek kullanıcı deneyimini yansıtır.

Raporun en kritik bölümü "Kötü URL'ler" listesidir. Bu listedeki URL'ler, sayfa deneyimi sinyallerinde negatif ağırlık taşır ve sıralama dezavantajına maruz kalır. Düzeltme önceliği, kötü performans gösteren URL'lerin organik trafik payına göre belirlenmelidir. Yüksek trafikli sayfaların CWV sorunları, düşük trafikli sayfalara kıyasla çok daha acil müdahale gerektirir.

Mobil Kullanılabilirlik Raporunun UX Sinyalleri

Deneyim > Mobil Kullanılabilirlik raporu, mobil cihazlarda kullanıcı deneyimini etkileyen sorunları listeler. "Metin çok küçük", "Tıklanabilir öğeler birbirine çok yakın", "İçerik viewport'tan geniş" ve "Viewport ayarlanmamış" gibi uyarılar bu raporda görüntülenir.

Her uyarı kategorisi etkilenen URL sayısıyla birlikte raporlanır. Uyarıya tıklandığında etkilenen URL örnekleri listelenir. Düzeltme yapıldıktan sonra "Düzeltmeyi Doğrula" butonuyla yeniden tarama talep edilir. Doğrulama süreci ortalama 7 ila 14 gün sürer. Bu süre boyunca rapor "Doğrulama başlatıldı" statüsünde kalır. Doğrulama başarılıysa uyarı "Geçti" olarak güncellenir.

Bağlantılar Raporunun Backlink Analizi İçin Kullanımı

Bağlantılar raporu iki bölümden oluşur: harici bağlantılar ve dahili bağlantılar. Harici bağlantılar bölümü, siteye en çok bağlantı veren domain'leri, en çok bağlantı alan sayfaları ve en sık kullanılan anchor text'leri listeler.

Bu veri, backlink profilinin genel sağlığını değerlendirmek için başlangıç noktasıdır. En çok bağlantı alan sayfalar, sitenin otorite merkezlerini temsil eder. Bu sayfalardan site içi bağlantılarla diğer sayfalara otorite dağıtımı yapılmalıdır. Anchor text raporu, dağılım anomalilerini tespit etmek için kullanılır. Tek bir anchor text'in baskın olması manipülasyon sinyali üretebilir. Dahili bağlantılar bölümü ise iç bağlantı stratejisinin etkinliğini gösterir. Düşük iç bağlantı alan sayfalar, site mimarisinde izole kalmış "yetim sayfalar" olarak değerlendirilir.

URL Denetim Aracının Teknik Kullanımı

URL Denetim aracı, tek bir URL'nin dizin durumunu, tarama verilerini ve render sonucunu detaylı olarak gösterir. Üst kısımdaki arama çubuğuna URL girildiğinde, o URL'ye ait son tarama bilgisi, canonical URL, dizin durumu ve sayfa deneyimi verileri görüntülenir.

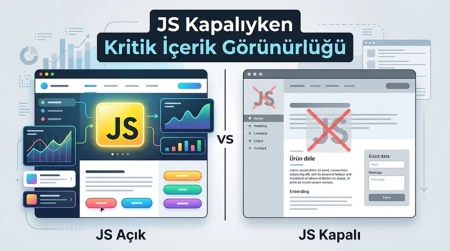

"Canlı URL'yi test et" butonu, URL'nin o anki durumunu gerçek zamanlı olarak test eder. Bu test, son tarama ile mevcut durum arasındaki farkları ortaya koyar. Örneğin, bir düzeltme yapıldıktan sonra canlı test ile düzeltmenin uygulandığı doğrulanır. Test sonucunda render edilmiş HTML ve ekran görüntüsü de gösterilir. JavaScript ile render edilen içeriğin Googlebot tarafından doğru görüntülenip görüntülenmediği bu ekran görüntüsünden kontrol edilir.

Search Console API ile Otomatik Veri Çekme

Manuel rapor kontrolü ölçeklenebilir değildir. Search Console API, performans verilerini programatik olarak çekmeye ve otomatik raporlama pipeline'larına beslemeye olanak tanır. API, Python client library ile erişilebilir:

from google.oauth2 import service_account

from googleapiclient.discovery import build

SCOPES = ['https://www.googleapis.com/auth/webmasters.readonly']

credentials = service_account.Credentials.from_service_account_file(

'service-account.json', scopes=SCOPES

)

service = build('searchconsole', 'v1', credentials=credentials)

request = {

'startDate': '2026-03-01',

'endDate': '2026-03-31',

'dimensions': ['query', 'page'],

'rowLimit': 1000,

'dimensionFilterGroups': [{

'filters': [{

'dimension': 'country',

'operator': 'equals',

'expression': 'tur'

}]

}]

}

response = service.searchanalytics().query(

siteUrl='sc-domain:site.com',

body=request

).execute()

for row in response.get('rows', []):

query = row['keys'][0]

page = row['keys'][1]

clicks = row['clicks']

impressions = row['impressions']

ctr = row['ctr']

position = row['position']

print(f'{query} | {page} | {clicks} | {impressions} | {ctr:.2%} | {position:.1f}')

Bu script, Mart 2026 döneminde Türkiye'den gelen sorguları sayfa bazında çeker ve performans metriklerini listeler. dimensionFilterGroups ile ülke, cihaz ve sorgu filtreleri uygulanabilir. rowLimit parametresi maksimum 25.000 satır destekler, daha büyük veri setleri için tarih aralığı daraltılarak birden fazla istek yapılmalıdır.

Otomatik Performans Düşüş Uyarı Sistemi

API verileriyle otomatik uyarı sistemi kurmak, performans düşüşlerini erken tespit etmeyi sağlar. Haftalık performans verisi çekilir, önceki haftayla karşılaştırılır ve eşik değerlerin altına düşen metrikler uyarı olarak raporlanır:

def performans_uyari(mevcut, onceki, esik_yuzde=15):

uyarilar = []

metrikler = {

'clicks': 'Tıklama',

'impressions': 'Gösterim',

'ctr': 'CTR',

'position': 'Pozisyon'

}

for metrik, isim in metrikler.items():

m_val = mevcut.get(metrik, 0)

o_val = onceki.get(metrik, 0)

if o_val == 0:

continue

degisim = ((m_val - o_val) / o_val) * 100

if metrik == 'position':

if degisim > esik_yuzde:

uyarilar.append(f'{isim} kötüleşti: {o_val:.1f} -> {m_val:.1f} ({degisim:+.1f}%)')

else:

if degisim < -esik_yuzde:

uyarilar.append(f'{isim} düştü: {o_val:.0f} -> {m_val:.0f} ({degisim:+.1f}%)')

return uyarilar

Bu fonksiyon, tıklama, gösterim veya CTR'de yüzde 15'ten fazla düşüş ya da pozisyonda yüzde 15'ten fazla kötüleşme tespit ettiğinde uyarı üretir. Cron job ile haftalık çalıştırıldığında, performans değişimleri otomatik olarak izlenir.

Sorgu Gruplandırma ve Tematik Performans Analizi

Binlerce sorgunun tek tek analizi pratik değildir. Sorguları tematik gruplara ayırmak, konu bazında performans trendlerini izlemeyi sağlar. Python ile regex tabanlı gruplandırma:

import re

tema_gruplari = {

'teknik_seo': r'crawl|robots|sitemap|canonical|redirect|hreflang',

'icerik_stratejisi': r'content|icerik|keyword|anahtar kelime|baslik',

'performans': r'core web|lcp|cls|inp|hiz|speed|cache',

'yapisal_veri': r'schema|structured|zengin sonuc|rich result',

'backlink': r'backlink|link building|disavow|anchor text'

}

def sorgu_grupla(query):

query_lower = query.lower()

for grup, pattern in tema_gruplari.items():

if re.search(pattern, query_lower):

return grup

return 'diger'

# API'den çekilen sorgulara uygulama

for row in response.get('rows', []):

query = row['keys'][0]

grup = sorgu_grupla(query)

row['tema'] = grup

Gruplandırılmış veriler, her tema için toplam tıklama, gösterim ve ortalama pozisyon hesaplanarak raporlanır. "Teknik SEO" grubu güçlü performans gösterirken "yapısal veri" grubu zayıfsa, yapısal veri içeriklerinin güncellenmesi öncelik alır. Bu yaklaşım, içerik stratejisi kararlarını veri odaklı hale getirir.

Usta Notu: Deneyimli ile Acemiyi Ayıran Fark

Deneyimli SEO uzmanlarını acemilerden ayıran fark tam da bu noktadadır: acemiler Search Console'daki toplam tıklama rakamına bakar ve aydan aya karşılaştırma yapar. Deneyimli uzmanlar ise sorgu bazında pozisyon değişimlerini izler ve marka sorgularını (brand queries) rapordan çıkardıktan sonra performansı değerlendirir. Toplam tıklama artışı, aslında marka bilinirliği artışından kaynaklanan marka sorgusu büyümesini maskeler. Marka sorguları filtrelendiğinde gerçek organik büyüme ortaya çıkar. Search Console Performans raporunda "Sorgu" filtresine marka adını yazıp "İçermez" seçeneğini uygulamak, marka dışı organik performansı izole eder. Bu tek filtreleme adımı, raporun stratejik değerini kökten değiştirir.

Sayfa Hızı Verilerinin Search Console Bağlamında Yorumlanması

Core Web Vitals raporu, saha verilerine (field data) dayanır ve Lighthouse gibi laboratuvar verilerinden farklı sonuçlar üretebilir. CrUX verileri, gerçek kullanıcıların 28 günlük kümülatif deneyimini yansıtır. Dolayısıyla bir düzeltme yapıldıktan sonra raporun iyileşmesi en az 28 gün sürer.

Sayfa gruplaması da dikkat gerektirir. Search Console, benzer URL yapısına sahip sayfaları gruplayarak raporlar. Tek bir sayfanın CWV sorununu düzeltmek, grubun tamamının statüsünü değiştirebilir. Aksine, bir gruptaki tek bir sorunlu sayfa, tüm grubun "Kötü" olarak işaretlenmesine neden olabilir. Rapordaki URL gruplarının hangi sayfaları kapsadığını kontrol etmek ve sorunlu sayfayı izole etmek önemlidir.

Güvenlik ve Manuel İşlemler Paneli

Güvenlik ve Manuel İşlemler bölümü iki alt rapor içerir. Manuel İşlemler raporu, kalite ekibi tarafından uygulanan doğrudan yaptırımları listeler. Güvenlik Sorunları raporu ise malware, phishing veya hack edilmiş içerik tespitlerini gösterir.

Manuel işlem bildiriminde "Sitenize yönlendirilen doğal olmayan bağlantılar", "Sitenizden giden doğal olmayan bağlantılar", "İnce içerik" veya "Spam" gibi kategoriler yer alabilir. Her bildirim, etkilenen URL'ler veya sitenin tamamı hakkında olabilir. Düzeltme sonrası "Yeniden İnceleme Talebi" gönderilir ve ortalama 2 ila 4 hafta içinde yanıt alınır. Bu panelin boş olması normal durumdur ve düzenli kontrol ile boş kalması sağlanmalıdır.

Kaldırma Aracının Stratejik Kullanımı

Kaldırma aracı üç işlev sunar: geçici kaldırma (6 ay süreyle dizinden çıkarma), önbelleğe alınmış URL'yi temizleme ve SafeSearch filtreleme. Geçici kaldırma, acil durumlarda hassas içeriğin veya hatalı sayfaların arama sonuçlarından hızla çıkarılması için kullanılır.

Geçici kaldırma işlemi 6 ay sonra otomatik olarak sona erer. Kalıcı çıkarma için sayfanın 404 veya 410 döndürmesi ya da noindex etiketi taşıması gerekir. Geçici kaldırma, kalıcı çözüm uygulanana kadar zaman kazandıran bir acil müdahale aracıdır. Kötüye kullanılması, dizin kapsamının gereksiz yere daraltılmasına yol açar. Yalnızca gerçekten acil olan durumlar (gizli veri sızıntısı, yasal zorunluluk) için kullanılmalıdır.

Uluslararası Hedefleme ve Hreflang Raporu

Çok dilli veya çok bölgeli siteler için Search Console'un eski arayüzünde bulunan "Uluslararası Hedefleme" raporu, hreflang etiketlerinin doğruluğunu kontrol eder. Hreflang hataları (dönüş etiketi eksik, bilinmeyen dil kodu, yanlış URL) bu raporda listelenir.

Hreflang hatalarının düzeltilmesi, doğru dil versiyonunun doğru ülkeye gösterilmesini sağlar. Yaygın hatalardan biri, dönüş etiketi (return tag) eksikliğidir: A sayfası B sayfasına hreflang ile işaret ediyorsa, B sayfası da A sayfasına işaret etmelidir. Bu çift yönlü ilişki sağlanmadığında hreflang bildirimi geçersiz kabul edilir. Rapordaki hataların sıfırlanması, uluslararası SEO performansının temelini oluşturur.

Yapısal Veri Raporlarının Rich Result Takibi

Search Console, sitedeki yapısal veri uygulamalarını türlerine göre ayrı raporlarda izler. FAQ, Article, Product, BreadcrumbList, VideoObject ve diğer şema türlerinin her biri için ayrı bir rapor sayfası bulunur. Her rapor, geçerli ve hatalı öğe sayısını gösterir.

Hatalı öğelerde zorunlu alan eksiklikleri, geçersiz değerler ve yapısal hatalar raporlanır. Uyarılı öğelerde ise önerilen ancak zorunlu olmayan alan eksiklikleri belirtilir. Hatasız ve uyarısız öğeler "Geçerli" statüsünde listelenir. Zengin sonuç uygunluğu yalnızca geçerli öğelerde mümkündür. Düzeltme sonrası "Düzeltmeyi Doğrula" ile yeniden tarama talep edilir ve doğrulama süreci başlatılır.

Veri Dışa Aktarma ve Arşivleme Stratejisi

Search Console verileri 16 aylık bir pencereyle sınırlıdır. Bu pencere dışındaki veriler kalıcı olarak kaybolur. Uzun dönem trend analizi ve yıllık karşılaştırma yapabilmek için verilerin düzenli olarak dışa aktarılıp arşivlenmesi gerekir.

Aylık arşivleme rutini: her ayın ilk haftasında önceki ayın performans verisi API veya arayüz üzerinden CSV olarak dışa aktarılır. Dosya isimlendirmesinde gsc-performans-2026-03.csv formatı kullanılır. Veriler bulut depolamaya (Google Cloud Storage, AWS S3) yüklenir ve BigQuery'ye import edilir. Bu arşiv, 16 aylık pencereden bağımsız olarak tüm geçmiş verilere erişim sağlar.

#!/bin/bash

AY=$(date -d "last month" +%Y-%m)

BASLANGIC=$(date -d "last month" +%Y-%m-01)

BITIS=$(date -d "$(date +%Y-%m-01) -1 day" +%Y-%m-%d)

python3 gsc_export.py \

--site "sc-domain:site.com" \

--start "$BASLANGIC" \

--end "$BITIS" \

--output "gsc-performans-${AY}.csv"

gsutil cp "gsc-performans-${AY}.csv" gs://seo-arsiv/gsc/

echo "GSC verisi arşivlendi: ${AY}"

Bu betik cron job ile her ayın 5'inde çalıştırılır ve önceki ayın verilerini otomatik olarak dışa aktarıp bulut depolamaya yükler.

Search Console Verisinin GA4 ile Çapraz Analizi

Search Console organik arama verisini, GA4 site içi davranış verisini sunar. İki veri kaynağının birleştirilmesi, organik trafiğin site içi performansını ölçmeyi sağlar. GA4'te Search Console entegrasyonu Yönetici > Ürün bağlantıları > Search Console bağlantısı yolundan yapılır.

Entegrasyon tamamlandığında GA4'ün "Edinme" raporlarında "Google organik arama sorguları" ve "Google organik arama trafiği" tabloları görünür. Bu tablolar, Search Console sorgu verilerini GA4 etkileşim metrikleriyle (oturum süresi, oturum başına sayfa, dönüşüm) birleştirir. Hangi sorguların en yüksek dönüşüm oranı ürettiğini görmek, içerik stratejisinde hangi konuların önceliklendirilmesi gerektiğini doğrudan belirler.

Looker Studio ile Search Console Dashboard Oluşturma

Search Console verilerini görselleştirmek ve paydaşlarla paylaşmak için Looker Studio (eski Data Studio) entegrasyonu kullanılır. Looker Studio'da "Veri kaynağı ekle" adımında "Search Console" seçeneği ile doğrudan bağlantı kurulur. Site impression ve URL impression olmak üzere iki tablo türü sunulur.

SEO dashboard'unda bulunması gereken minimum bileşenler: haftalık tıklama ve gösterim trend çizgisi, en çok tıklama alan ilk 20 sorgu tablosu, CTR dağılımı histogram grafiği, cihaz bazında (mobil vs masaüstü) trafik karşılaştırması ve pozisyon dağılımı çubuk grafiği. Dashboard'un haftalık otomatik e-posta ile paydaşlara gönderilmesi, raporlama sürecini tamamen otomatikleştirir.

Regex Filtrelerin İleri Düzey Kullanımı

Search Console Performans raporunda regex filtreler, sorgu ve sayfa analizinde güçlü bir segmentasyon aracıdır. "Sorgu" filtresinde "Özel (regex)" seçeneği ile karmaşık filtreleme kuralları uygulanabilir.

Örnek regex filtreler:

# "nasıl" veya "nedir" içeren bilgi amaçlı sorguları filtrele

nasıl|nedir|ne demek|rehber

# Belirli konu kümesini filtrele

(crawl|tarama).*(budget|bütçe)|(robots\.txt)

# 3+ kelimeli uzun kuyruk sorguları yakala

\S+\s+\S+\s+\S+

# Marka sorgularını hariç tut (negatif filtre)

^(?!.*seobaz).*$

LinkedIn üzerindeki SEO veri analizi topluluklarında paylaşılan pratiklere göre, regex filtreleme kullanan analistler standart filtrelere kıyasla yüzde 40 daha hızlı fırsat tespiti yapmaktadır. Regex yetkinliği, Search Console verisinden maksimum değer çıkarmak için kritik bir tekniktir.

Anomali Tespiti ve Algoritmik Güncelleme İzleme

Organik performansta ani değişimler, algoritmik güncelleme veya teknik sorundan kaynaklanabilir. Her iki senaryonun ayırt edilmesi farklı müdahale stratejileri gerektirir. Algoritmik güncellemeler tüm sektörü etkiler, teknik sorunlar ise yalnızca tek siteyi etkiler.

Anomali tespiti için üç katmanlı kontrol uygulanır: birinci katmanda Search Console tıklama verisinde yüzde 15'in üzerinde günlük değişim izlenir. İkinci katmanda sektördeki diğer sitelerin aynı dönemde benzer değişim yaşayıp yaşamadığı kontrol edilir. Üçüncü katmanda Dizin Oluşturma raporunda dizin kapsamı değişikliği olup olmadığı doğrulanır. Üç katmanın birlikte değerlendirilmesi, sorunun kaynağını yüksek doğrulukla belirlemeyi sağlar.

🚀 Şimdi Harekete Geçin

Bu rehberi teori olmaktan çıkar — 5 farklı AI ile test et veya ekibinle paylaş.

SEOBAZ

SEOBAZ