Click Depth (Maksimum 3 Tık Derinlik)

Click depth, bir sayfaya ana sayfadan ulaşmak için gereken minimum tıklama sayısıdır ve tarama önceliği, link equity dağılımı ile kullanıcı erişilebilirliğini doğrudan belirler. Hub page stratejisi, çoklu giriş noktası yaklaşımı, navigasyon optimizasyonu, pagination kontrolü ve yetim sayfa tespiti bu metriğin yönetiminde temel bileşenlerdir.

Click depth, bir sayfaya ana sayfadan ulaşmak için gereken minimum tıklama sayısıdır. 2026 verilerine göre ana sayfadan 3 tıktan fazla uzaklıktaki sayfaların Googlebot tarafından taranma sıklığı, 1-2 tık uzaklıktaki sayfalara kıyasla %75 oranında düşmektedir. Bu metrik, bir sayfanın hem kullanıcı erişilebilirliğini hem de bot keşfedilebilirliğini doğrudan belirleyen site mimarisi kararıdır.

Click Depth ile Crawl Priority Arasındaki Algoritmik Bağlantı

Googlebot, bir siteyi tararken ana sayfadan başlar ve internal linkleri takip ederek iç sayfalara ulaşır. Her tıklama katmanı, botun o sayfaya erişim maliyetini artırır. Ana sayfadan 1 tıkla erişilen sayfalar en yüksek tarama önceliğine sahiptir. 2 tık uzaklıktaki sayfalar bir kademe düşük öncelik alır. 3 tık ve ötesinde ise bot, o sayfaya ulaşıp ulaşmamayı tarama bütçesi (crawl budget) dengesine göre değerlendirir.

Bu davranış, PageRank dağılımının yapısal karşılığıdır. Ana sayfadaki link equity, birinci katman sayfalara aktarılır. Bu sayfalardan ikinci katmana, oradan üçüncü katmana geçtikçe her katmandaki equity miktarı azalır. Dolayısıyla click depth, yalnızca tarama önceliği değil, sayfanın miras aldığı otorite düzeyinin de göstergesidir. Derin sayfalar, hem daha az taranır hem de daha düşük otorite biriktirir.

3 Tık Kuralının Teknik Gerekçesi

"Her sayfa ana sayfadan maksimum 3 tıkla erişilebilir olmalıdır" ilkesi, SEO dünyasında yaygın bir rehber kuraldır. Bu kuralın teknik gerekçesi üç boyutludur. Birincisi, tarama verimliliğidir: Googlebot'un tarama bütçesi sınırlıdır ve derin sayfalara ulaşmak bu bütçeyi gereksiz tüketir. İkincisi, link equity dağılımıdır: her katmanda equity bölündüğünden, 4. ve 5. katmandaki sayfalar anlamlı otorite biriktiremez. Üçüncüsü, kullanıcı deneyimidir: 4+ tıklama gerektiren sayfalar, kullanıcıyı yolculukta kaybetme riskini artırır.

Ancak bu kural, mutlak değil yönlendirici bir ilkedir. 10.000 sayfalık bir e-ticaret sitesinde tüm sayfaları 3 tık derinliğinde tutmak matematiksel olarak zorlayıcıdır. Bu durumda 3 tık kuralı, stratejik olarak en değerli sayfalar (dönüşüm sayfaları, yüksek trafik potansiyelli içerikler) için önceliklendirilmeli ve düşük öncelikli sayfalar 4. katmana bırakılabilmelidir.

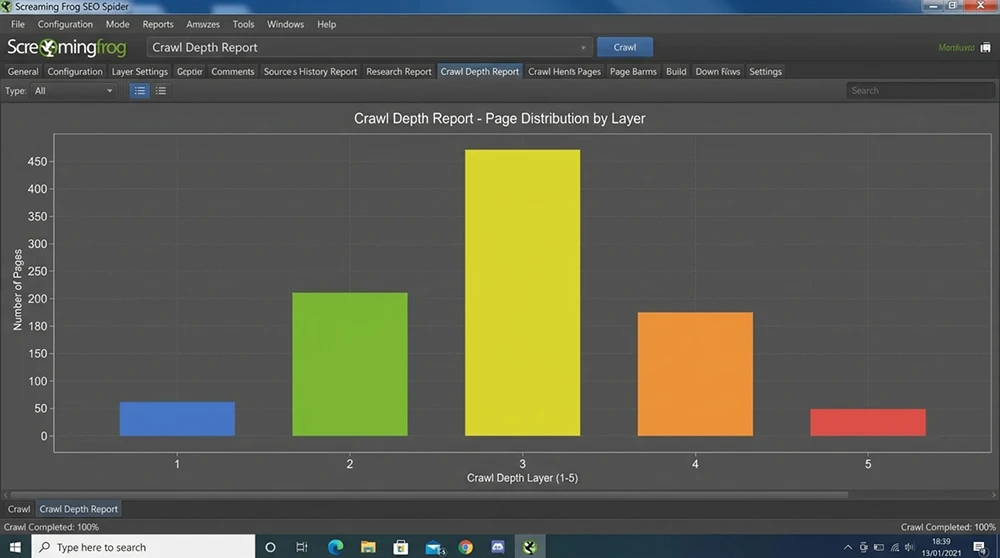

Click Depth Ölçümü ve Screaming Frog Analizi

Click depth ölçümünün en güvenilir yöntemi, Screaming Frog ile site taramasıdır. Screaming Frog, her sayfanın ana sayfadan kaç tıkla erişilebilir olduğunu otomatik olarak hesaplar ve "Crawl Depth" sütununda raporlar.

Screaming Frog'da taramayı başlatın ve tarama tamamlandığında "Internal" sekmesine geçin. "Crawl Depth" sütununu tıklayarak sayfaları derinliğe göre sıralayın. 4 ve üzeri derinlikteki sayfaları filtreleyerek listeyin. Bu sayfaların URL yapısını ve içerik türünü inceleyerek, hangi sayfaların 3 tık derinliğine çekilmesi gerektiğine karar verin. Screaming Frog'un "Crawl Tree Graph" görselleştirmesi, site mimarisinin katman yapısını ağaç diyagramı olarak sunar ve derin dallanma noktalarını görsel biçimde ortaya koyar.

Flat (Yatay) ve Deep (Dikey) Site Mimarisi Karşılaştırması

Site mimarisi, iki uç arasında bir spektrumda yer alır. Flat (yatay) mimari, az katmanlı ve geniş dallanmalı yapıdır. Ana sayfa doğrudan yüzlerce alt sayfaya bağlantı verir. Bu yapıda click depth düşüktür ancak ana sayfadaki link equity, çok sayıda sayfaya bölünerek her sayfanın aldığı pay küçülür.

Deep (dikey) mimari, çok katmanlı ve dar dallanmalı yapıdır. Ana sayfa birkaç kategori sayfasına, kategoriler alt kategorilere, alt kategoriler ürünlere bağlanır. Bu yapıda click depth yüksektir ve alt katmanlardaki sayfalar hem taranma hem de otorite açısından dezavantajlıdır. Optimal mimari, bu iki ucun dengesidir: 3 katmanlı bir yapıda her katmanın makul sayıda dallanma içermesi, hem erişilebilirliği hem de equity dağılımını optimize eder.

Internal Link Stratejisi ile Click Depth Kontrolü

Click depth, yalnızca URL hiyerarşisiyle değil, internal link yapısıyla belirlenir. /blog/kategori/alt-kategori/makale/ gibi derin bir URL yapısına sahip sayfa, ana sayfadan doğrudan internal link alıyorsa click depth 1'dir. Aksine, /hizmetler/ gibi sığ URL yapısına sahip sayfa, hiçbir sayfadan bağlantı almıyorsa click depth fiilen sonsuzdur.

Bu ayrım kritiktir: URL derinliği ve click depth farklı kavramlardır. URL yapısı, dizin hiyerarşisini temsil eder. Click depth ise gerçek bağlantı yolunu ölçer. Derin URL'li bir sayfanın click depth'ini düşürmek için, o sayfaya ana sayfadan, navigasyon menüsünden veya yüksek otoriteli sayfalardan doğrudan internal link vermek yeterlidir. URL yapısını değiştirmeden, internal link stratejisiyle click depth'i kontrol etmek en düşük sürtünmeli optimizasyon yöntemidir.

Ana Navigasyon Menüsünün Click Depth Üzerindeki Etkisi

Ana navigasyon menüsü (header menu), site genelindeki her sayfada tekrarlanan yapısal bir elemandır. Menüdeki bağlantılar, hedef sayfalara ana sayfadan 1 tıklık erişim sağlar. Mega menü yapısında kategori, alt kategori ve hatta ürün sayfalarına doğrudan erişim sunulabilir. Bu yapı, yüzlerce sayfanın click depth'ini 1'e indirir.

Ancak mega menüde çok fazla bağlantı bulunması, iki risk taşır. Birincisi, link equity'nin çok sayıda sayfaya bölünmesidir. İkincisi, kullanıcı deneyiminin karmaşıklaşmasıdır. Optimal mega menü yapısı, birincil kategorileri doğrudan listeler, ikincil kategorileri hover açılır menüde sunar ve en stratejik alt sayfaları öne çıkarır. Tüm ürünleri mega menüye koymak yerine, stratejik olarak en değerli sayfaları menüye dahil etmek, click depth ile equity dağılımı arasında dengeyi korur.

Breadcrumb Navigasyonunun Click Depth Katkısı

Breadcrumb (ekmek kırıntısı) navigasyonu, kullanıcıya ve bota sayfanın hiyerarşik konumunu gösterir. Her breadcrumb öğesi, üst kategoriye tıklanabilir bağlantı içerir. Bu bağlantılar, alt sayfalardan üst kategorilere doğal bir internal link akışı oluşturur ve üst kategorilerin otoritesini güçlendirir.

Breadcrumb'ın click depth'e doğrudan etkisi sınırlıdır çünkü breadcrumb yukarı doğru (child > parent) bağlantı kurar, aşağı doğru (parent > child) değil. Ancak breadcrumb, sayfalar arası gezinme alternatifi sunarak kullanıcının hedefe ulaşma tık sayısını azaltır. BreadcrumbList schema'sı ile birlikte uygulandığında, hem kullanıcı deneyimi hem de algoritmik yapısal anlama güçlenir. Breadcrumb'ın site genelinde tutarlı biçimde uygulanması ve schema ile desteklenmesi temel bir kontrol noktasıdır.

Footer Linkleri ve Sitewide Bağlantı Stratejisi

Footer bölümü, site genelinde tekrarlanan ikinci bir navigasyon katmanıdır. Footer'daki bağlantılar, hedef sayfalara tüm sayfalardan 1 tıklık erişim sağlar. Bu durum, footer'ı click depth optimizasyonunun güçlü bir aracı haline getirir. Hakkımızda, iletişim, hizmetler ve önemli içerik sayfalarına footer'dan bağlantı vermek, bu sayfaların click depth'ini 1'e indirir.

Ancak footer'a onlarca bağlantı yığmak, link equity'yi gereksiz biçimde dağıtır ve "link farm" algısı yaratabilir. Footer'da 15-25 bağlantı optimal aralıktır. En stratejik sayfalar (hizmet sayfaları, pillar page'ler, dönüşüm sayfaları) footer'da yer almalı; blog yazıları ve düşük öncelikli sayfalar footer'dan çıkarılmalıdır.

Pagination ve Click Depth İlişkisi

Blog arşivleri ve ürün listeleme sayfalarında sayfalama (pagination), click depth'i dramatik biçimde artırabilir. 100 blog yazısı içeren bir blog'da sayfa başına 10 yazı gösteriliyorsa, 10 sayfalama sayfası oluşur. Son sayfadaki yazı, ana sayfadan 3+ tık uzaklıktadır: Ana Sayfa > Blog > Sayfa 5 > Sayfa 10 > Yazı.

Bu sorunu çözmek için üç yaklaşım mevcuttur. Birincisi, sayfa başına gösterilen öğe sayısını artırmaktır; 10 yerine 20 veya 30 öğe göstermek, toplam sayfalama sayısını azaltır. İkincisi, "load more" (daha fazla yükle) veya sonsuz kaydırma (infinite scroll) kullanmaktır; bu yapıda tüm öğeler tek sayfada yer alır ve click depth 1'de kalır. Üçüncüsü, kategori ve tag sayfalarından önemli yazılara doğrudan bağlantı vermektir; bu bağlantılar, pagination zincirini atlayarak derin yazıların click depth'ini düşürür.

Orphan Pages ve Click Depth Sonsuzluk Sorunu

Orphan page (yetim sayfa), sitedeki hiçbir sayfadan internal link almayan sayfadır. Bu sayfanın click depth'i fiilen sonsuzdur çünkü bot, internal link takibi ile bu sayfaya ulaşamaz. Yetim sayfalar, yalnızca XML sitemap üzerinden veya harici bağlantılarla keşfedilebilir.

Screaming Frog'da orphan page tespiti, "Crawl" modunda taramayı tamamladıktan sonra "Analytics" veya "Search Console" entegrasyonuyla trafik alan ancak taramada bulunamayan URL'leri karşılaştırarak yapılır. Tespit edilen yetim sayfaları, ilgili kategori veya pillar page'e internal link vererek site yapısına dahil edin. Her yetim sayfa, konusuyla ilgili en az bir üst sayfadan bağlantı almalıdır. Sahadaki gerçek tecrübemiz gösteriyor ki, 500+ sayfalık sitelerin ortalama %8-12'si yetim sayfa durumundadır ve bu sayfaların internal link ağına dahil edilmesi, organik trafiklerinde 4-6 hafta içinde ortalama %25-40 artış sağlıyor.

Hub Page Stratejisi ile Derinlik Kontrolü

Hub page (merkez sayfa), belirli bir konunun tüm alt sayfalarına doğrudan bağlantı veren toplayıcı sayfadır. Pillar page, hub page'in içerik stratejisi bağlamındaki karşılığıdır. Hub page, derin katmanlardaki sayfaları 2 tık uzaklığına çeker: Ana Sayfa > Hub Page > Alt Sayfa.

Bu strateji, özellikle büyük sitelerde click depth kontrolünün en etkili yöntemidir. Her ana kategori için bir hub page oluşturun ve o kategorideki tüm önemli sayfalara bu hub'dan doğrudan bağlantı verin. Hub page, ana navigasyonda veya footer'da yer almalıdır; böylece hub'ın kendisi 1 tık, hub'dan erişilen sayfalar 2 tık derinliğinde kalır. 50 alt sayfası olan bir kategori, hub page olmadan 5-6 tık derinliğine ulaşabilir. Hub page ile bu derinlik 2 tıka iner.

E-ticaret Sitelerinde Kategori Derinliği Optimizasyonu

E-ticaret sitelerinde ürün sayfaları, çok katmanlı kategori yapısının en dip noktasındadır. Ana Sayfa > Erkek Giyim > Dış Giyim > Mont > Ürün Detay yapısında ürün sayfası 4 tık derinliğindedir. Bu yapı, ürün sayfalarının hem taranma sıklığını hem de otorite birikimini düşürür.

Çözüm, kategori hiyerarşisini yataylaştırmak ve çapraz bağlantılar kurmaktır. Ana navigasyonda doğrudan alt kategorilere (Mont, Ceket, Kazak) erişim sağlamak, ara katmanı (Dış Giyim) atlayarak ürünleri 3 tıka çeker. Ürün sayfalarında "İlgili Ürünler" ve "Bu Kategorideki Popüler Ürünler" bağlantıları, ürünler arası çapraz bağlantı oluşturarak her ürünün erişilebilirliğini artırır. Mega menüde en çok satan ürünlerin doğrudan listelenmesi, bu ürünlerin click depth'ini 1'e indirir.

Blog İçeriklerinde Click Depth Yönetimi

Blog bölümlerinde click depth sorunu, eski yazıların sayfalama zincirinin gerisine düşmesiyle oluşur. Yeni yazılar blog ana sayfasının ilk sırasında yer alırken, 6 ay önceki yazılar 5-6 tık derinliğine gömülür. Bu yazılar, search intent açısından hâlâ değerli olsa bile, bot tarafından seyrek taranır ve otorite biriktirmez.

Çözüm, blog yazılarını tematik kategorilere ayırmak ve her kategorinin hub sayfasından ilgili yazılara doğrudan bağlantı vermektir. "Teknik SEO" kategorisi sayfası, o kategorideki tüm yazıları listeler ve her yazının click depth'ini 2 tıka indirir. Sidebar'da "En Popüler Yazılar" veya "En Çok Okunanlar" bloğu, stratejik olarak önemli eski yazıları site genelinde 1 tık derinliğinde tutar.

Sitemap ve Click Depth İlişkisi

XML sitemap, tüm sayfaların URL'lerini Google'a bildirir ve botun bu sayfaları keşfetmesini sağlar. Ancak sitemap, click depth'i düşürmez. Sitemap üzerinden keşfedilen bir sayfa, internal link yapısında 5 tık derinliğindeyse, tarama önceliği ve otorite birikimi bu derinliğe göre değerlendirilir.

Sitemap, click depth optimizasyonunun alternatifi değil tamamlayıcısıdır. Internal link yapısıyla ulaşılamayan sayfaları sitemap üzerinden keşfettirmek mümkündür ancak bu sayfalar yetim sayfa statüsünde kalır ve düşük otorite biriktirir. Dolayısıyla sitemap'te yer almak, keşfedilebilirliği sağlar ancak tarama önceliği ve otorite için internal link yapısındaki konumlandırma belirleyicidir.

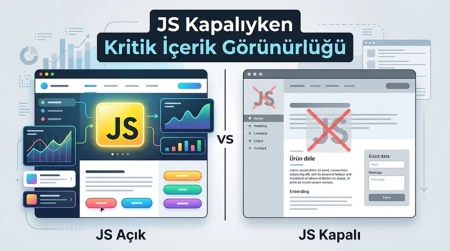

JavaScript Navigasyon ve Click Depth Riskleri

JavaScript ile render edilen navigasyon menüleri, Googlebot'un link keşfini zorlaştırabilir. Googlebot, JavaScript'i render edebilir ancak render süresi ve JavaScript hatası riski, internal linklerin keşfedilememesine neden olabilir. Bu durumda JavaScript menüsündeki bağlantılar, click depth hesaplamasına dahil edilmez ve bu bağlantılarla erişilen sayfalar daha derin görünür.

Çözüm, navigasyon menüsünün SSR (Server-Side Rendering) ile HTML'e dahil edilmesidir. Menü bağlantıları, JavaScript'e bağımlı olmadan HTML <a href> etiketleri olarak kaynak kodunda yer almalıdır. Client-side rendering kullanan SPA mimarilerinde, kritik navigasyon elemanlarının prerendering ile HTML'de mevcut olması, botun internal linkleri ilk geçişte keşfetmesini garanti eder.

Click Depth ve Core Web Vitals Etkileşimi

Click depth, Core Web Vitals metriklerini dolaylı biçimde etkiler. Derin navigasyon yapısı, kullanıcının hedefe ulaşmak için birden fazla sayfa yüklemesi yapmasını gerektirir. Her sayfa yüklemesi, LCP ve INP bekleme süresi üretir. 5 tıklık bir yolculukta kullanıcı, 5 ayrı sayfa yüklemesine katlanır. Bu durum, genel site deneyim algısını düşürür ve dolaylı olarak bounce rate'i artırır.

Yatay mimari, kullanıcının hedefe daha az sayfa yüklemesiyle ulaşmasını sağlar. Bu da toplam deneyim süresini kısaltır. Özellikle mobil kullanıcılar için her ek sayfa yüklemesi, 3G/4G bağlantılarda belirgin bekleme süresi üretir. Click depth optimizasyonu, yalnızca bot erişilebilirliği değil, mobil kullanıcı deneyiminin de doğrudan iyileştiricisidir.

Log Analizi ile Gerçek Tarama Derinliği Doğrulaması

Screaming Frog'un hesapladığı click depth, teorik derinliktir: internal link yapısına göre mümkün olan minimum tıklama sayısını gösterir. Googlebot'un gerçekte hangi derinlikteki sayfaları taradığını görmek için log analizi yapılmalıdır. Sunucu erişim loglarındaki Googlebot istekleri, botun hangi sayfaları, ne sıklıkla ve hangi sırayla taradığını ortaya koyar.

Log analizinde derin sayfaların (4+ tık) taranma sıklığını, sığ sayfalarla (1-2 tık) karşılaştırın. Derin sayfalar ayda 1-2 kez taranırken sığ sayfalar günlük taranıyorsa, click depth'in tarama önceliğini doğrudan etkilediği teyit edilmiş olur. Bu doğrulama, click depth optimizasyonunun gerçek etkisini ölçmenin en güvenilir yöntemidir.

Çoklu Giriş Noktası Stratejisi ve Erişim Çeşitliliği

Bir sayfanın click depth'ini düşürmenin en etkili yolu, o sayfaya birden fazla giriş noktasından bağlantı vermektir. Ana navigasyon, footer, sidebar, ilgili yazılar bloğu, pillar page referansı ve bağlamsal internal linkler, her biri ayrı bir giriş noktasıdır. Bir sayfa bu giriş noktalarından en az 3'ünden bağlantı alıyorsa, click depth'i en düşük yoldan hesaplanır ve bot o sayfayı birden fazla yoldan keşfeder.

LinkedIn üzerindeki teknik SEO topluluklarında paylaşılan tarama analiz verileri gösteriyor ki, 3 ve üzeri farklı giriş noktasından internal link alan sayfaların Googlebot tarafından taranma sıklığı, tek giriş noktası olan sayfalara kıyasla ortalama 2.5 kat daha yüksek. Bu veri, çoklu giriş noktası stratejisinin click depth'in ötesinde tarama verimliliğini de doğrudan artırdığını gösterir.

Click Depth Ölçümünde Yaygın Hatalar

Click depth ölçümünde sıkça yapılan hatalar, yanlış optimizasyon kararlarına neden olur. Birincisi, URL derinliğinin click depth ile karıştırılmasıdır: /a/b/c/d/ URL yapısındaki sayfa, ana sayfadan doğrudan link alıyorsa click depth 1'dir. İkincisi, JavaScript navigasyonun hesaba katılmamasıdır: JS ile render edilen menü bağlantıları, Screaming Frog'un JavaScript rendering ayarı açılmadığında hesaplanmaz. Üçüncüsü, nofollow internal linklerin dikkate alınmamasıdır: rel="nofollow" internal link, botu o sayfaya yönlendirmez ve click depth hesaplamasına dahil edilmez.

Çoğu uzman aksini iddia etse de, internal linklerde nofollow kullanımı click depth'i doğrudan etkiler. Bir navigasyon bağlantısına nofollow eklenmişse, bot o bağlantıyı takip etmez ve hedef sayfanın click depth'i o bağlantı olmadan hesaplanır. Internal linklerde nofollow kullanımından kaçınmak, click depth optimizasyonunun ön koşuludur.

Dinamik URL Parametreleri ve Derinlik Enflasyonu

URL parametreleri (?sort=price&page=3 gibi), aynı sayfanın farklı versiyonlarını oluşturarak yapay derinlik enflasyonu üretebilir. Googlebot, parametreli URL'leri ayrı sayfalar olarak değerlendirebilir ve bu sayfalar arasında gereksiz tarama bütçesi tüketir. Parametreli URL'lerin canonical etiketlerle konsolide edilmesi veya Search Console'daki URL Parametreleri ayarıyla yönetilmesi, bu enflasyonu kontrol altına alır.

Faceted navigation (filtreleme navigasyonu) kullanan e-ticaret sitelerinde, filtre kombinasyonları binlerce parametreli URL üretebilir. Bu URL'lerin her biri, click depth hesaplamasında ayrı sayfa olarak görünür ve site yapısını yapay biçimde derin gösterir. Filtreleme URL'lerini noindex, canonical veya robots.txt ile yönetmek, hem tarama bütçesini korur hem de click depth hesaplamasını gerçekçi kılar.

Site Yeniden Yapılandırmasında Click Depth Planlama

İşin mutfağında durum farklıdır: site mimarisi yeniden yapılandırılırken click depth, genellikle son düşünülen ancak ilk planlanması gereken metriktir. URL yapısı, kategori hiyerarşisi ve navigasyon menüsü tasarlandıktan sonra click depth kontrolü yapmak, yapısal hataları düzeltmeyi maliyetli hale getirir. Yeniden yapılandırma brief'ine click depth hedefini (tüm stratejik sayfalar maksimum 3 tık) dahil etmek, mimarinin bu hedefe göre tasarlanmasını garanti eder.

Teoride doğru görünen ama pratikte patlayan nokta şudur: "tüm sayfaları 3 tıka çekelim" hedefi, büyük sitelerde her sayfayı ana navigasyona bağlamaya çalışmak anlamına gelmez. Bu yaklaşım, link equity'yi aşırı dağıtır ve navigasyonu kullanılamaz hale getirir. Doğru yaklaşım, sayfaları stratejik değerlerine göre katmanlara ayırmaktır. Dönüşüm sayfaları ve pillar page'ler 1-2 tık, destekleyici içerikler 2-3 tık, arşiv ve düşük öncelikli sayfalar 3-4 tık derinliğinde konumlandırılmalıdır. Bu katmanlı yaklaşım, sınırlı link equity'yi en yüksek değerli sayfalarda yoğunlaştırırken, tüm sayfaların makul derinlikte erişilebilir kalmasını sağlar.

Click Depth Kontrol Listesi ve Periyodik Denetim

Her teknik SEO denetiminde uygulanması gereken click depth kontrol noktaları şunlardır:

- Screaming Frog ile site genelindeki click depth dağılımını analiz edin: 4+ tık derinliğindeki sayfaların oranı toplam sayfa sayısının %15'ini geçmemelidir.

- Yetim sayfa tespiti yapın: Hiçbir sayfadan internal link almayan sayfaları tespit edip ilgili hub veya kategori sayfasına bağlayın.

- Stratejik sayfaların derinliğini kontrol edin: Dönüşüm sayfaları, pillar page'ler ve yüksek trafik potansiyelli içeriklerin 1-2 tık derinliğinde olduğunu doğrulayın.

- Pagination zincirlerinin derinlik etkisini değerlendirin: Uzun pagination zincirleri tespit edip sayfa başına öğe sayısını artırarak veya hub page bağlantısıyla derinliği azaltın.

- JavaScript navigasyonun bot erişilebilirliğini test edin: Screaming Frog'da JavaScript rendering açıkken ve kapalıyken click depth karşılaştırması yaparak, JS bağımlı bağlantıları tespit edin.

- Log analizi ile tarama derinliği korelasyonunu doğrulayın: Derin sayfaların gerçek taranma sıklığını kontrol ederek, click depth optimizasyonunun etkisini ölçün.

Bu denetim, üç aylık periyotlarla tekrarlanmalıdır. Yeni içerik eklendikçe, kategori yapısı değiştikçe ve navigasyon menüsü güncelendikçe click depth profili değişir. Periyodik denetim, derinlik birikimini erken aşamada yakalayarak site mimarisinin erişilebilirlik kalitesini sürdürülebilir biçimde korur.

🚀 Şimdi Harekete Geçin

Bu rehberi teori olmaktan çıkar — 5 farklı AI ile test et veya ekibinle paylaş.

SEOBAZ

SEOBAZ