LSI Kelimeler ve Vektörel Yakınlık

LSI kelimeler ve vektörel yakınlık, bir ana konuyla istatistiksel ve anlamsal olarak ilişkili terimlerin vektörel uzayda yakın konumlanması prensibine dayanan içerik optimizasyon disiplinidir. TF-IDF ağırlıklandırma, n-gram kalıp analizi, co-occurrence frekansı, entity ilişki ağı ve paragraf düzeyinde semantik tutarlılık bu disiplinin temel bileşenleridir.

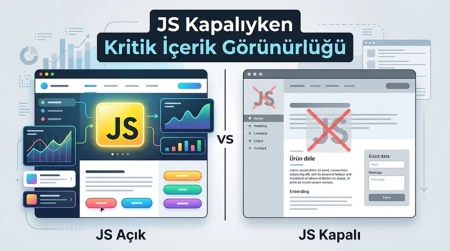

LSI (Latent Semantic Indexing) kelimeler, bir ana konuyla istatistiksel olarak birlikte geçme eğilimi gösteren ve o konunun anlamsal bağlamını tamamlayan ilişkili terimlerdir. 2026 itibarıyla Google'ın dil modelleri, anahtar kelime eşleşmesinin çok ötesinde vektörel uzayda anlamsal yakınlık hesaplayarak içerikleri değerlendirmektedir. Bir sayfanın "crawl budget" hakkında yazdığını iddia edip "Googlebot", "tarama hızı" veya "robots.txt" terimlerini hiç içermemesi, algoritmik perspektiften o sayfanın konuyu gerçekten ele almadığının güçlü göstergesidir.

LSI Kavramının Orijinal Tanımı ve Modern Yorumu

Latent Semantic Indexing, 1988'de Deerwester ve arkadaşları tarafından geliştirilen, büyük metin koleksiyonlarındaki gizli anlamsal yapıları ortaya çıkaran bir matris ayrıştırma (SVD) tekniğidir. Orijinal LSI, terim-doküman matrisini düşük boyutlu bir uzaya projekte ederek, aynı bağlamda kullanılan kelimelerin birbirine yakın konumlanmasını sağlar. Bu teknik, eş anlamlı kelimeleri ve ilişkili kavramları matematiksel olarak bir araya getirir.

Google'ın modern algoritması orijinal LSI'yı doğrudan kullanmaz. BERT, MUM ve Gemini gibi transformer tabanlı dil modelleri, çok daha gelişmiş anlamsal anlama kapasitesine sahiptir. Ancak SEO dünyasında "LSI kelimeleri" terimi, ilişkili ve bağlamsal terimleri tanımlamak için yaygın biçimde kullanılmaya devam etmektedir. Kavramın modern karşılığı, "semantik olarak ilişkili terimler" veya "topical relevance sinyalleri"dir. Bu terimler, bir konunun tam ve kapsamlı biçimde ele alındığını algoritmaya bildiren bağlamsal ipuçlarıdır.

Vektörel Uzay Modeli ve Kelime Temsilleri

Vektörel uzay modeli, her kelimeyi çok boyutlu bir uzayda sayısal bir vektör olarak temsil eder. Word2Vec, GloVe ve FastText gibi kelime gömme (word embedding) modelleri, büyük metin korpuslarında birlikte geçen kelimelerin vektörlerini birbirine yakın konumlandırır. "Kral" kelimesinin vektörü, "kraliçe" kelimesinin vektörüne "erkek-kadın" ilişkisi kadar yakındır.

Bu vektörel temsil, arama motorlarının anahtar kelime eşleşmesinin ötesine geçmesini sağlar. Kullanıcı "sayfa hızı iyileştirme" araması yaptığında, Google yalnızca bu tam ifadeyi içeren sayfaları değil, vektörel uzayda bu sorguya yakın konumlanan kavramları (LCP, TTFB, Core Web Vitals, lazy loading, CDN) içeren sayfaları da aday olarak değerlendirir. Dolayısıyla vektörel yakınlık, modern bilgi erişiminin matematiksel temelidir ve içerik optimizasyonunun odak noktasını "tam eşleşme"den "anlamsal kapsama"ya kaydırır.

TF-IDF ve Terim Ağırlıklandırma Mekanizması

TF-IDF (Term Frequency-Inverse Document Frequency), bir terimin belirli bir dokümandaki önemini ölçen istatistiksel metriktir. TF, terimin dokümanda kaç kez geçtiğini; IDF ise terimin tüm doküman koleksiyonunda ne kadar nadir olduğunu hesaplar. Yaygın terimler ("ve", "bir", "bu") düşük IDF skoru alır, nadir ve spesifik terimler ("crawl demand", "render budget") yüksek IDF skoru alır.

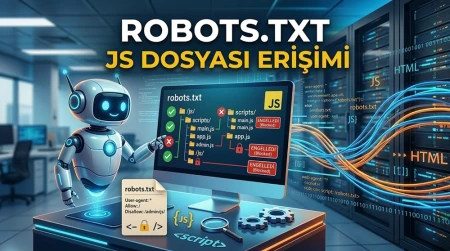

İçerik optimizasyonunda TF-IDF analizi, bir konunun kapsamlı ele alınıp alınmadığını tespit etmek için kullanılır. "Crawl budget" konusunda sıralanan ilk 10 sayfanın TF-IDF analizini yapıldığında, bu sayfalarda ortak olarak yüksek TF-IDF skoru alan terimler ortaya çıkar: "Googlebot", "tarama hızı", "robots.txt", "sitemap", "log analizi", "render kuyruğu". Bu terimler, konunun "olmazsa olmaz" bağlamsal bileşenleridir. Bu bileşenleri eksik bırakan bir sayfa, konuyu yeterince kapsamlı ele almamış demektir.

N-gram Analizi ve Çoklu Kelime Kalıpları

N-gram, ardışık kelime dizilerinin istatistiksel analizidir. Unigram tek kelime, bigram iki kelimelik kalıp, trigram üç kelimelik kalıptır. Arama motorları, yalnızca tekil kelimeleri değil, çoklu kelime kalıplarını da değerlendirir. "Crawl budget" bir bigram, "crawl rate limit" bir trigramdır. Bu kalıplar, tekil kelimelerin taşımadığı anlamsal bağlamı oluşturur.

"Budget" kelimesi tek başına finansal bağlam taşır. "Crawl budget" bigramı ise teknik SEO bağlamına taşır. Google'ın NLP modelleri, n-gram kalıplarını analiz ederek içeriğin hangi konu bağlamında yer aldığını belirler. Dolayısıyla içerikte yalnızca tekil anahtar kelimeleri değil, konuya özgü bigram ve trigram kalıplarını doğal biçimde kullanmak, anlamsal bağlamı güçlendirir. "Request-response döngüsü", "sunucu yanıt süresi", "tarama bütçesi optimizasyonu" gibi çoklu kelime kalıpları, konunun teknik derinliğini algoritmik düzeyde bildirir.

Google'ın BERT ve MUM Modellerinin Anlamsal Anlama Kapasitesi

BERT (Bidirectional Encoder Representations from Transformers), cümledeki her kelimenin anlamını hem önceki hem sonraki kelimelerle birlikte değerlendiren çift yönlü dil modelidir. MUM (Multitask Unified Model) ise BERT'ten 1000 kat daha güçlü olup, 75 dilde çalışan ve metin, görsel ve video içeriği birlikte analiz edebilen multimodal modeldir.

Bu modeller, LSI'nın istatistiksel yaklaşımının çok ötesinde, derin anlamsal anlama kapasitesine sahiptir. BERT, "Java programlama dili" ile "Java adası" arasındaki farkı bağlamdan anlayabilir. MUM ise "Fuji Dağı'na tırmanış hazırlığı" sorgusunu, ekipman, hava durumu, fiziksel kondisyon ve rota bilgisi gibi çoklu alt konulara ayrıştırarak değerlendirebilir. Bu kapasite, içerik optimizasyonunun "kelime sayısı" odağından "anlamsal kapsama" odağına evrilmesinin algoritmik gerekçesidir.

Anlamsal İlişki Türleri ve İçerik Bağlamı

Kelimeler arasındaki anlamsal ilişkiler farklı türlerde sınıflandırılır ve her tür, içerik bağlamına farklı katkı sağlar. Eş anlamlılar (synonyms): "tarama bütçesi" ve "crawl budget" aynı kavramı farklı dillerde ifade eder. Alt kavramlar (hyponyms): "crawl rate limit" ve "crawl demand", "crawl budget"ın alt bileşenleridir. Üst kavramlar (hypernyms): "teknik SEO", "crawl budget"ın ait olduğu üst kategoridir.

İlişkili kavramlar (related terms): "robots.txt", "sitemap", "log analizi" doğrudan crawl budget ile ilişkili ancak alt kavramı olmayan terimlerdir. Bağlamsal tetikleyiciler (contextual triggers): "Googlebot", "WRS", "tarama istatistikleri raporu" crawl budget konusunun ele alındığını gösteren bağlamsal ipuçlarıdır. Bu ilişki türlerinin tamamını doğal biçimde barındıran içerik, konuyu semantik olarak kapsamlı ele almış demektir ve vektörel uzayda o konunun merkezine yakın konumlanır.

Semantik İlişkili Terim Keşfi İçin Araç ve Yöntemler

Bir konunun semantik olarak ilişkili terimlerini keşfetmek, birden fazla kaynak ve aracın birlikte kullanılmasını gerektirir. Google'ın kendisi en güçlü kaynaktır: hedef sorguyu aratıp "İlgili Aramalar" bölümü ve "People Also Ask" kutularındaki terimleri toplamak, algoritmik olarak ilişkili kabul edilen kavramları ortaya koyar.

Surfer SEO ve Clearscope gibi içerik optimizasyon araçları, SERP'teki ilk 10-20 sayfanın TF-IDF analizini yaparak, içerikte bulunması gereken terimleri ve ideal kullanım sıklıklarını raporlar. Bu araçlar, "bu konuda sıralanan sayfaların ortak olarak kullandığı terimler" listesini sunar. AlsoAsked.com, PAA sorularını ağaç yapısında görselleştirerek ilişkili alt konuları haritalandırır. Wikipedia'nın ilgili makalesindeki bağlantılar ve referanslar da güçlü bir semantik ilişki kaynağıdır.

Entity ve Knowledge Graph İlişkisi Üzerinden Vektörel Bağlam

Google'ın Knowledge Graph'ı, kavramları entity olarak tanımlar ve entity'ler arasındaki ilişkileri bir graf yapısında modeller. "Crawl budget" entity'si, "Googlebot", "robots.txt", "sitemap", "TTFB" ve "Search Console" entity'leriyle bağlantılıdır. Bu bağlantılar, vektörel uzaydaki yakınlığın yapısal karşılığıdır.

İçerikte Knowledge Graph'taki ilişkili entity'leri doğal biçimde kullanmak, sayfanın o konunun entity ağına dahil olmasını sağlar. Yüksek otoriteli entity'leri (Google, Semrush, Ahrefs) ana özne yapmak yerine, teknik ve niş entity'leri (passage ranking, render budget, crawl demand) içeriğin iskeletine yerleştirmek, information gain ve vektörel farklılaşma açısından daha güçlü sonuç üretir. Bu strateji, Information Gain patentinin entity boyutudur: büyük entity'lerle doymuş bir bilgi alanında, niş entity'lerle farklılaşmak algoritmik ödüllendirmeyi tetikler.

Co-occurrence ve Birlikte Geçme Frekansı

Co-occurrence (birlikte geçme), iki terimin aynı dokümanda, aynı paragrafta veya aynı cümlede birlikte yer alma sıklığıdır. Arama motorları, yüksek co-occurrence frekansına sahip terim çiftlerini ilişkili olarak değerlendirir. "SSL" ve "TLS" terimleri yüksek co-occurrence'a sahiptir; birlikte geçmeleri, konunun doğru bağlamda ele alındığını gösterir.

İçerik optimizasyonunda co-occurrence prensibi, ilişkili terimlerin yalnızca aynı sayfada değil, mümkünse aynı paragraf veya cümle bloğunda yer almasını gerektirir. "Crawl budget optimizasyonu" paragrafında "robots.txt yapılandırması" ve "sitemap bildirimi" terimlerinin doğal biçimde geçmesi, bu üç kavramın co-occurrence ilişkisini güçlendirir. Terimleri sayfanın farklı uçlarına dağıtmak, co-occurrence sinyalini zayıflatır.

Semantik Yoğunluk ve Anahtar Kelime Doldurma Ayrımı

Semantik yoğunluk, bir sayfadaki ilişkili terimlerin çeşitliliğini ve doğal dağılımını ifade eder. Anahtar kelime doldurma (keyword stuffing) ise aynı terimin yapay biçimde tekrarlanmasıdır. Bu iki kavram birbirine karıştırılmamalıdır. Semantik yoğunluk, farklı ilişkili terimlerin doğal biçimde kullanılmasıdır ve algoritmik olarak ödüllendirilir. Keyword stuffing, aynı terimin aşırı tekrarıdır ve algoritmik olarak cezalandırılır.

"Crawl budget" terimini bir paragrafta 10 kez tekrarlamak keyword stuffing'dir. Aynı paragrafta "crawl budget", "tarama kapasitesi", "Googlebot tarama hızı", "crawl rate limit" ve "crawl demand" terimlerini doğal biçimde kullanmak ise semantik yoğunluktur. İlk yaklaşım tek boyutlu ve yapay, ikincisi çok boyutlu ve doğaldır. Vektörel uzay modelinde ilk yaklaşım, aynı noktada yığılma üretir. İkinci yaklaşım, konunun etrafında geniş bir semantik alan kaplar.

Surfer SEO ve Clearscope ile İçerik Skor Optimizasyonu

Surfer SEO, Clearscope, MarketMuse ve Frase gibi içerik optimizasyon araçları, hedef anahtar kelime için SERP'teki en iyi performans gösteren sayfaları analiz eder ve bu sayfaların ortak olarak kullandığı terimleri, ideal kullanım sıklıklarını ve içerik yapısını raporlar. Bu araçlar, içeriğin "semantik tamlık" skorunu hesaplar ve eksik terimleri tespit eder.

Surfer SEO'nun "Content Editor" aracı, yazı yazılırken gerçek zamanlı skor hesaplar. Hedef terimler kullanıldıkça skor artar, aşırı kullanıldığında uyarı verir. Bu araçlar, yazarın sezgisel kararlarını veri destekli hale getirir. Ancak araç önerilerini körü körüne takip etmek, içeriği "araç için optimize edilmiş" ancak "okuyucu için doğal olmayan" bir yapıya sürükleyebilir. Sahadaki gerçek tecrübemiz gösteriyor ki, araç skorunu %80-90 bandında tutup geri kalan %10-20'yi editoryal yargıyla dolduran içerikler, %100 skor hedefleyen içeriklere kıyasla hem sıralamada hem de kullanıcı metriklerinde daha iyi performans gösteriyor.

Vektörel Yakınlık ve LLM Alıntılama İlişkisi

LLM tabanlı cevap motorları, kullanıcı sorgusunu vektörel uzayda temsil eder ve web içeriklerini bu sorgu vektörüne yakınlıklarına göre değerlendirir. Sorgu vektörüne en yakın içerik bloğu, alıntılama adayı olarak seçilir. Bu yakınlık, yalnızca anahtar kelime eşleşmesiyle değil, semantik bağlam zenginliğiyle belirlenir.

Bir paragraf "crawl budget" terimini tekrarlasa bile, ilişkili terimleri (Googlebot, tarama hızı, robots.txt, render kuyruğu) barındırmıyorsa, vektörel uzayda "crawl budget nedir" sorgu vektöründen uzak konumlanır. Aksine, ilişkili terimleri doğal biçimde barındıran paragraf, sorgu vektörüne daha yakındır ve alıntılanma olasılığı artar. Dolayısıyla vektörel yakınlık optimizasyonu, hem klasik SEO hem de GEO'nun ortak paydasıdır.

Türkçe İçeriklerde Semantik İlişki ve Morfolojik Zorluklar

Türkçe, aglutinatif (eklemeli) bir dildir. Aynı kök kelime, onlarca farklı ek alabilir: "optimizasyon", "optimizasyonu", "optimizasyonun", "optimizasyonuyla", "optimizasyonlarını". Bu morfolojik çeşitlilik, vektörel uzayda aynı kavramın farklı formlarının birbirine yakın konumlanmasını zorlaştırır. Google'ın Türkçe NLP kapasitesi, bu formları aynı kök kavrama bağlayabilir ancak tam doğruluk oranı İngilizce kadar yüksek değildir.

Bu zorluk, içerik optimizasyonunda iki pratik sonuç doğurur. Birincisi, anahtar kelimenin yalın formunun (ek almamış hali) başlıklarda ve ilk cümlelerde kullanılması, algoritmik eşleşme skorunu artırır. "Crawl budget optimizasyonu" ifadesinin H2 başlığında tam bu formda yer alması, eklemeli formlarına kıyasla daha güçlü sinyal üretir. İkincisi, ilişkili terimlerin hem Türkçe hem İngilizce formlarını doğal biçimde kullanmak, çift dilli semantik kapsama sağlar. "Tarama bütçesi (crawl budget)" ifadesi, her iki dildeki sorguların vektörel yakınlığını birlikte güçlendirir.

Semantik Kapsama ve Konu Tamlığı Değerlendirmesi

Bir içeriğin konuyu semantik olarak tam kapsaması, o konunun tüm alt bileşenlerini, ilişkili kavramlarını ve bağlamsal tetikleyicilerini barındırması demektir. Bu tamlık, TF-IDF analizi, co-occurrence kontrolü ve entity kapsama değerlendirmesiyle ölçülür.

Konu tamlığı değerlendirmesinin pratik yöntemi şöyledir: hedef anahtar kelime için SERP'teki ilk 5 sayfanın içerik yapısını analiz edin. Bu sayfaların tamamında yer alan terimler, "zorunlu bağlam terimleri"dir ve içeriğinizde de bulunmalıdır. Bu sayfaların yalnızca 1-2'sinde yer alan terimler, "farklılaştırıcı terimler"dir ve bunları eklemek information gain sağlar. Hiçbir sayfada yer almayan ancak konuyla ilişkili terimler ise "keşif terimleri"dir ve bunları eklemek güçlü vektörel farklılaşma üretir.

Paragraf Düzeyinde Semantik Tutarlılık

Vektörel yakınlık, yalnızca sayfa düzeyinde değil, paragraf düzeyinde de değerlendirilir. Google'ın passage ranking sistemi, sayfa içindeki her paragrafı bağımsız bir bilgi ünitesi olarak skorlar. Bir paragrafın semantik tutarlılığı, paragraftaki terimlerin tek bir konu etrafında yoğunlaşmasıyla ölçülür.

Bir paragrafta "crawl budget", "robots.txt", "sitemap" ve "tarama hızı" terimlerinin birlikte geçmesi, yüksek semantik tutarlılık üretir. Aynı paragrafta "crawl budget", "font-display", "CLS" ve "structured data" terimlerinin birlikte geçmesi ise düşük semantik tutarlılık üretir; çünkü bu terimler farklı konu kümelerine aittir. Her paragrafın tek bir konu kümesine odaklanması, passage ranking'de o paragrafın ilgili sorgulara daha güçlü yanıt vermesini sağlar.

Semantik Boşluk Tespiti ve İçerik Zenginleştirme

Mevcut içeriklerde semantik boşlukları tespit etmek, günceleme stratejisinin en etkili bileşenidir. Surfer SEO veya Clearscope ile mevcut içeriği analiz ettiğinizde, araç "bu terimler içeriğinizde eksik" listesini sunar. Bu eksik terimler, semantik boşluklardır ve içeriğe eklendiklerinde vektörel kapsama genişler.

Ancak eksik terimleri yapay biçimde eklemek, doğallık ilkesine aykırıdır. Her eksik terim, içeriğin doğal akışına entegre edilmelidir. Yeni bir paragraf ekleyerek, mevcut bir paragrafı genişleterek veya örnek/vaka çalışması ekleyerek eksik terimleri doğal biçimde dahil etmek, hem semantik tamlığı hem de okuyucu deneyimini birlikte güçlendirir.

Konu Kümesi (Topic Cluster) ve Vektörel Yakınlık Sinerjisi

Topic cluster yapısında, pillar page geniş semantik alanı kapsar ve cluster page'ler spesifik alt konulara odaklanır. Pillar page, konunun tüm ilişkili terimlerini yüzeysel düzeyde barındırır. Her cluster page ise kendi alt konusunun terimlerini derinlemesine kapsar. Bu yapı, vektörel uzayda pillar page'in konunun merkezine yakın konumlanmasını ve cluster page'lerin spesifik alt sorguların merkezine yakın konumlanmasını sağlar.

Internal linkler, bu vektörel kümelenmeyi algoritmik olarak teyit eder. Pillar page'den cluster page'e verilen bağlantılar, iki sayfanın aynı konu kümesine ait olduğunu bildirir. Bu bildirim, her iki sayfanın da ilgili sorgularda güçlenmesine katkıda bulunur. Topic cluster ve vektörel yakınlık sinerjisi, topical authority'nin matematiksel temelidir.

Word2Vec ve Kelime Gömme Modellerinin İçerik Stratejisine Etkisi

Word2Vec gibi kelime gömme modelleri, kelimelerin vektörel temsillerini öğrenerek "kral - erkek + kadın = kraliçe" gibi analogiler üretebilir. Bu modeller, SEO bağlamında "bir kavramla ilişkili diğer kavramları" keşfetmek için kullanılabilir. "Crawl budget" vektörüne en yakın vektörleri sorguladığınızda, o konunun semantik komşularını elde edersiniz.

Python'da gensim kütüphanesiyle eğitilmiş Word2Vec modeli üzerinden semantik komşu keşfi yapılabilir. Ancak bu teknik analiz, çoğu SEO profesyoneli için pratik değildir. Surfer SEO ve Clearscope gibi araçlar, bu tür vektörel analizlerin sonuçlarını kullanıcı dostu arayüzle sunar. Dolayısıyla vektörel yakınlık kavramını anlamak stratejik kararları şekillendirir; uygulama ise araçlar aracılığıyla gerçekleştirilir.

Çoğu Uzmanın Gözden Kaçırdığı LSI Yanlış Anlamaları

SEO dünyasında LSI hakkında yaygın yanlış anlamalar mevcuttur. Birincisi, "Google LSI kullanıyor" iddiasıdır. Google mühendisleri, Google'ın orijinal LSI algoritmasını kullanmadığını açıkça belirtmiştir. Google, çok daha gelişmiş NLP modelleri kullanır. "LSI kelimeleri" terimi, semantik ilişkili terimlerin kısayol adı olarak yaygınlaşmıştır ancak teknik olarak yanlıştır.

İkincisi, "LSI anahtar kelime üreteçleri" aldatıcı araçlardır. LSIGraph ve benzeri araçlar, gerçek LSI analizi yapmaz; Google Suggest ve ilişkili aramalardan terim listesi derler. Bu araçların çıktısı yararlı olabilir ancak "LSI" etiketini taşıması teknik açıdan hatalıdır. Üçüncüsü, "ne kadar çok LSI kelime kullanırsam o kadar iyi sıralanırım" inancıdır. Çoğu uzman aksini iddia etse de, semantik ilişkili terimlerin aşırı kullanımı, doğallık algısını bozar ve algoritmik değerlendirmede negatif sinyal üretebilir. Doğal akış içinde kullanılan 15-20 ilişkili terim, zorla sıkıştırılmış 50 terimden daha güçlü semantik sinyal üretir.

Vektörel Farklılaşma ve Information Gain İlişkisi

Vektörel uzayda farklılaşma, information gain'in matematiksel karşılığıdır. Aynı konudaki tüm içerikler, vektörel uzayda bir küme oluşturur. Bu kümenin merkezine yakın içerikler, genel kabul görmüş bilgiyi tekrarlayan içeriklerdir. Kümenin kenarına veya dışına uzanan içerikler ise benzersiz bilgi sunan, farklı perspektif getiren veya niş alt konuları ele alan içeriklerdir.

İçeriğin vektörel uzayda küme merkezine yakın konumlanması "güvenli" ancak "sıradan" demektir. Kümenin kenarına doğru uzanması ise "farklılaşmış" ve potansiyel olarak "ödüllendirilmiş" demektir. Bu farklılaşma, rakiplerin kullanmadığı niş terimleri, benzersiz veri noktalarını ve orijinal çıkarımları barındırmakla sağlanır. Dolayısıyla semantik optimizasyonun iki boyutu vardır: temel terimleri kapsayarak kümeye dahil olmak (zorunlu), farklılaştırıcı terimlerle kümeden öne çıkmak (stratejik).

İçerik Güncelleme ve Semantik Zenginleştirme Döngüsü

LinkedIn üzerindeki SEO mühendislik topluluklarında paylaşılan içerik performans analizleri gösteriyor ki, yayınlanmış içeriklere semantik boşluk tespiti sonrası yapılan zenginleştirme güncellemeleri, organik trafikte ortalama %20-35 artış sağlıyor. Bu güncelleme, yeni paragraflar ekleme, mevcut paragrafları genişletme ve eksik ilişkili terimleri doğal biçimde entegre etme biçiminde gerçekleştirilir.

Güncelleme döngüsünde Surfer SEO veya Clearscope ile mevcut içeriğin semantik tamlık skorunu kontrol edin. Eksik terimleri tespit edip, bu terimlerin doğal biçimde dahil edileceği bağlamlar oluşturun. Güncelleme sonrası içeriğin lastmod tarihini güncelleyin ve Google'ın yeniden taramasını tetikleyin. Bu döngüyü 6-12 aylık periyotlarla tekrarlamak, içeriğin semantik güncelliğini ve vektörel kapsama alanını sürdürülebilir biçimde korur.

Semantik Optimizasyon Kontrol Listesi

Her içerik üretimi ve güncelleme sürecinde uygulanması gereken semantik kontrol noktaları şunlardır:

- SERP'teki ilk 10 sayfanın ortak terimlerini kapsayın: Surfer SEO veya Clearscope ile zorunlu bağlam terimlerini tespit edip içeriğe doğal biçimde dahil edin.

- Konunun alt bileşen entity'lerini barındırın: Knowledge Graph'taki ilişkili entity'leri içeriğin iskeletine yerleştirerek vektörel kapsama alanını genişletin.

- Paragraf düzeyinde semantik tutarlılığı koruyun: Her paragrafın tek bir konu kümesine odaklanmasını sağlayarak passage ranking performansını güçlendirin.

- Niş ve teknik terimleri farklılaştırıcı olarak kullanın: Rakiplerin kullanmadığı ancak konuyla ilişkili niş entity'leri ekleyerek information gain ve vektörel farklılaşma sağlayın.

- N-gram kalıplarını doğal biçimde kullanın: Tekil kelimeler yerine bigram ve trigram kalıplarını doğal cümle yapısı içinde kullanarak anlamsal bağlamı güçlendirin.

- Anahtar kelime doldurma sınırını aşmayın: Araç skorunu %80-90 bandında tutup geri kalanı editoryal yargıyla dengeleyerek doğallık ilkesini koruyun.

Vektörel Yakınlığın Geleceği ve Multimodal Anlam

İşin mutfağında durum farklıdır: vektörel yakınlık kavramı, metin dünyasıyla sınırlı kalmayacak biçimde genişlemektedir. Google'ın MUM modeli, metin, görsel ve video içeriği aynı vektörel uzayda temsil eder. Bir ürün görseli, o ürünün metin açıklamasıyla aynı vektörel konumda yer alır. Bu multimodal temsil, görsellerin alt text'inin, video transkriptlerinin ve infografik içeriklerinin semantik değerini doğrudan artırır.

Teoride doğru görünen ama pratikte patlayan nokta şudur: vektörel yakınlık optimizasyonu "bir kez yapıp bırakılacak" bir operasyon değildir. Google'ın dil modelleri sürekli güncellenir, vektörel temsiller yeniden hesaplanır ve kelimeler arasındaki ilişki ağırlıkları değişir. Bugün güçlü vektörel yakınlık üreten bir terim kombinasyonu, yeni model güncellemesiyle farklı ağırlık alabilir. Dolayısıyla semantik optimizasyon, periyodik analiz ve güncelleme gerektiren yaşayan bir disiplindir. İçeriğin semantik güncelliğini ve vektörel kapsama kalitesini düzenli olarak değerlendirmek, uzun vadeli sıralama performansının sürdürülebilirliğini garanti eden tek yaklaşımdır.

🚀 Şimdi Harekete Geçin

Bu rehberi teori olmaktan çıkar — 5 farklı AI ile test et veya ekibinle paylaş.

SEOBAZ

SEOBAZ